Keputusan Etis Anthropic Membawa Keuntungan Meski Kehilangan Kontrak $200 Juta

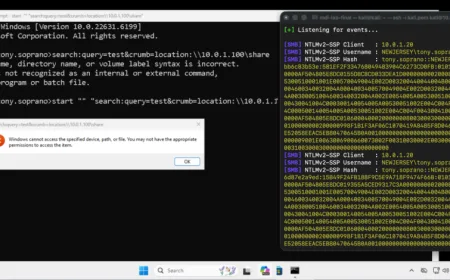

Pada pandangan pertama, pekan lalu tampak seperti bencana bagi Anthropic, perusahaan kecerdasan buatan (AI) yang memilih untuk menolak kontrak senilai $200 juta dari Departemen Pertahanan Amerika Serikat (DoD). Keputusan ini diambil karena Anthropic menolak agar produknya digunakan untuk pengawasan massal terhadap warga Amerika atau untuk mengoperasikan senjata otonom tanpa pengawasan manusia.

Akibatnya, DoD membatalkan kontrak tersebut. Presiden Donald Trump bahkan menyebut Anthropic sebagai "kelompok kiri ekstrem" dan memerintahkan seluruh lembaga federal menghentikan penggunaan produk perusahaan itu. Menteri Pertahanan Pete Hegseth menyebut Anthropic sebagai "Risiko Rantai Pasokan bagi Keamanan Nasional". Sementara itu, pesaing utama Anthropic, OpenAI, dengan cepat menandatangani kontrak serupa dengan Pentagon.

Respons Pasar dan Kepercayaan Pengguna

Meskipun keputusan Anthropic menimbulkan risiko besar, beberapa indikasi awal menunjukkan bahwa sikap berdasarkan prinsip etika ini mungkin berbuah manis.

Perdebatan publik yang terjadi ternyata lebih efektif dibandingkan dengan kampanye iklan mahal. Setelah kampanye Super Bowl awal tahun ini, model AI Anthropic, Claude, masuk dalam daftar 10 aplikasi gratis terpopuler di Amerika menurut Apple. Menyusul pengumuman Hegseth, aplikasi Claude langsung melesat ke posisi teratas dan tetap bertahan hingga saat ini. Jumlah unduhan mencapai lebih dari 1 juta per hari, menurut Chief Product Officer Anthropic. Juru bicara perusahaan menyatakan, "Kami memecahkan rekor pendaftaran setiap hari sejak awal minggu lalu di semua negara tempat Claude tersedia."

Tidak hanya banyak yang mendaftar, pengguna juga meninggalkan aplikasi pesaing. Pada 28 Februari, uninstall aplikasi ChatGPT milik OpenAI melonjak hingga 295 persen, bersamaan dengan munculnya laporan tentang kesepakatan OpenAI dengan Pentagon. Ulasan bintang satu meningkat hampir 800 persen dan ulasan bintang lima menurun setengahnya.

Dukungan dari Insinyur dan Industri AI

Lebih penting lagi, Anthropic mendapatkan kepercayaan dan dukungan luas dari para insinyur dalam industri AI. Surat dukungan beredar di kalangan karyawan perusahaan pesaing, dengan lebih dari 850 tanda tangan pada Senin lalu. Banyak dari mereka menuntut perusahaan mereka untuk bersolidaritas dengan prinsip Anthropic dan menegakkan batasan serupa. Beberapa bahkan mengancam akan keluar jika permintaan tersebut tidak diindahkan.

Dukungan ini juga datang dari luar Silicon Valley. Denver Riggleman, mantan anggota DPR dari Partai Republik yang kini memimpin perusahaan keamanan siber, awalnya mempertimbangkan banyak opsi untuk mitra AI. Namun, sikap Anthropic membuatnya memutuskan hanya bekerja sama dengan perusahaan tersebut. "Anthropic memiliki garis merah yang tidak bisa dinegosiasikan," katanya, "dan kami pun punya prinsip yang sama."

Kontroversi Label "Risiko Rantai Pasokan" dan Legalitasnya

Menurut pengalaman Riggleman dalam tugas kongres terkait AI dan ancaman asing, keputusan Hegseth untuk melabeli Anthropic sebagai risiko rantai pasokan kemungkinan besar akan digugat dan dibatalkan di pengadilan. Pemerintah AS biasanya menggunakan label tersebut untuk perusahaan asing yang dianggap bermusuhan, seperti Huawei. Namun, ini adalah kali pertama label itu dijadikan senjata balasan atas penolakan syarat kontrak bisnis.

"Mengatakan keputusan ini berdasar hukum yang kuat, akan menjadi pernyataan yang terlalu murah," kata Riggleman.

Ia juga menyoroti bahwa pemerintah kini tidak lagi melindungi masyarakat dari risiko teknologi, melainkan justru melemahkan pengawasan yang ada. "Kita belum menyadari sepenuhnya apa artinya perusahaan swasta mengendalikan informasi dalam jumlah besar tentang warga," imbuhnya.

Perbedaan Pendekatan Anthropic dan OpenAI

Departemen Pertahanan menyatakan bahwa kontrak yang ditawarkan pada Anthropic sudah mengandung jaminan cukup, salah satunya melalui klausul penggunaan AI hanya untuk "semua tujuan yang sah." Namun, Anthropic berargumen bahwa klausul ini tidak cukup kuat karena bisa berubah mengikuti perintah eksekutif baru atau interpretasi undang-undang yang berbeda.

"Kami tidak ingin menjual sesuatu yang bisa menyebabkan kematian orang-orang kami sendiri atau orang tak bersalah," kata CEO Anthropic, Dario Amodei.

Sementara itu, OpenAI menyatakan bahwa kesepakatannya dengan Pentagon lebih aman dengan larangan eksplisit terhadap pengawasan massal dan senjata otonom. Namun, klausul "semua tujuan yang sah" masih ada, sehingga perlindungan tersebut bergantung pada apakah DoD akan menghormati norma hukum. CEO OpenAI, Sam Altman, mengakui bahwa kontrak tersebut "sangat terburu-buru" dan "tampaknya buruk secara citra." Perusahaan kemudian menambahkan pembatasan terhadap pengawasan, meskipun banyak pihak meragukan efektivitasnya.

Pengalaman Pribadi sebagai Pilot dan Keputusan Etis

Penulis, Ken Harbaugh, mantan pilot Angkatan Laut AS, mengaitkan pengalaman masa lalu saat menandatangani dokumen yang melarang pengawasan warga sipil, hingga perannya sebagai komandan pesawat pengintai tempur saat 9/11. Ia menegaskan bahwa selama ini, keputusan hidup dan mati harus selalu berada di tangan manusia, bukan mesin.

Dalam konflik antara Anthropic dan Pentagon, sebuah perusahaan swasta memegang teguh prinsip itu terhadap pemerintahnya sendiri. Menurut Harbaugh, Anthropic mungkin kehilangan kontrak besar, tetapi memperoleh sesuatu yang jauh lebih berharga: kepercayaan dan reputasi dalam industri AI yang sulit didapatkan.

Analisis Redaksi

Menurut pandangan redaksi, sikap tegas Anthropic menandai sebuah titik balik penting dalam etika pengembangan teknologi AI. Dalam era di mana perusahaan teknologi semakin dekat dengan pemerintah, keberanian menolak kontrak besar demi mempertahankan nilai-nilai kemanusiaan menunjukkan bahwa kepercayaan pengguna dan integritas perusahaan dapat menjadi aset strategis yang lebih berharga daripada keuntungan finansial jangka pendek.

Selain itu, gelombang dukungan yang datang dari para insinyur hingga mantan pejabat memperlihatkan bahwa industri AI kini menghadapi tuntutan untuk transparansi dan akuntabilitas lebih tinggi. Jika perusahaan-perusahaan tidak mengikuti jejak Anthropic, mereka menghadapi risiko kehilangan talenta dan kepercayaan pasar yang sulit diperbaiki.

Kedepannya, yang perlu diperhatikan adalah bagaimana pemerintah AS dan dunia mengatur penggunaan AI dalam konteks keamanan nasional tanpa mengorbankan hak-hak sipil dan prinsip etika. Langkah Anthropic bisa menjadi preseden yang memaksa pembuat kebijakan untuk lebih berhati-hati dan membuka dialog publik yang lebih luas tentang batasan teknologi.

Dengan meningkatnya kekhawatiran terhadap pemanfaatan AI untuk pengawasan dan senjata otonom, kisah Anthropic juga mengingatkan kita bahwa nilai kemanusiaan harus tetap menjadi prioritas utama dalam revolusi teknologi ini.

What's Your Reaction?

Like

0

Like

0

Dislike

0

Dislike

0

Love

0

Love

0

Funny

0

Funny

0

Angry

0

Angry

0

Sad

0

Sad

0

Wow

0

Wow

0

:strip_icc():format(jpeg)/kly-media-production/medias/5488956/original/064020100_1769771942-pppk_bgn_-_klaim.jpg)

:strip_icc():format(jpeg)/kly-media-production/medias/6482158/original/048799000_1779341643-cek_fakta_-_padat_karya.jpg)

![[QUIZ] Apakah Kamu Pencemburu? Cek dari Cara Memperlakukan Orang](https://cdn.indowarta.com/uploads/images/202605/image_450x280_6a1a60d27eec4.webp)

/data/photo/2026/05/30/6a1a2ef452cca.jpg)