Menguji Bukti Saya Bukan AI: Bahkan Bibi Saya Tidak Yakin

- Eksperimen Mengejutkan Bersama Bibi

- Ketika Bukti Kehidupan Jadi Kontroversi

- Analisis Ahli: Video Netanyahu Asli Tapi Sulit Dipercaya

- Bisakah Anda Membuktikan Anda Bukan Robot?

- Solusi Tradisional: Kata Sandi Rahasia

- Ancaman Nyata Deepfake di Kehidupan Sehari-hari

- Dampak "Dividen Pembohong" dan Krisis Kepercayaan

- Pengalaman Pribadi dan Refleksi Akhir

- Analisis Redaksi

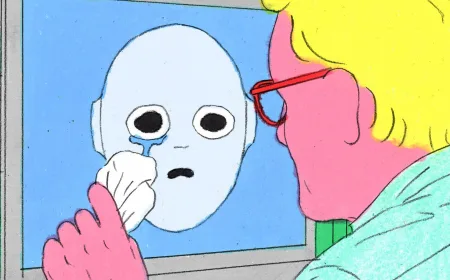

Saya mencoba membuktikan bahwa saya bukan AI. Namun, bahkan bibi saya sendiri tidak yakin apakah yang diajak bicara adalah saya atau deepfake. Teknologi kecerdasan buatan (AI) saat ini sudah sangat canggih sehingga perdana menteri aktif pun kesulitan membuktikan dirinya nyata. Apakah Anda juga bisa menjadi korban?

Eksperimen Mengejutkan Bersama Bibi

Beberapa hari lalu, saya menelepon bibi saya, Eleanor, dan meminta bantuannya untuk sebuah eksperimen sederhana. "Ini untuk sebuah artikel," kata saya. Saya jelaskan bahwa nanti dia akan menerima panggilan lagi dan bisa jadi yang menjawab adalah saya asli atau AI deepfake. Bisa kah seseorang yang mengenal saya seumur hidup membedakannya?

Awalnya, bibi saya tidak percaya ada AI terlibat. "Suaramu terdengar seperti kamu," ujarnya. "Menurutku, orang asli menggunakan intonasi lebih banyak daripada yang aku duga pada suara AI." Saya mencoba meyakinkannya bahwa teknologi AI sudah makin maju. Ada jeda sejenak. "Aku kira 90% yakin," katanya ragu, "tapi suara itu terdengar agak artifisial."

Ketika Bukti Kehidupan Jadi Kontroversi

Biasanya, kekhawatiran tentang deepfake adalah tentang Anda ditipu. Memang benar, karena AI digunakan untuk penipuan besar, menyebar informasi palsu, dan mengganggu pemilu. Tapi bagaimana jika Anda yang dituduh sebagai deepfake? Bagaimana cara membuktikan Anda nyata?

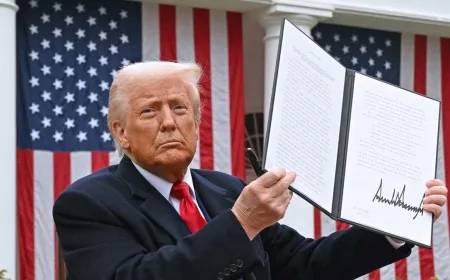

Pertanyaan itu bahkan harus dijawab oleh Perdana Menteri Israel, Benjamin Netanyahu, bulan ini. Ia memposting video yang memperlihatkan ilusi optik sebuah jari keenam pada tangan kanannya, yang biasanya menjadi ciri khas deepfake. Internet pun ramai dengan rumor Netanyahu telah meninggal akibat serangan misil dan pemerintah menutupinya. Beberapa hari kemudian, ia mengunggah video lain dari sebuah kedai kopi, dengan senyum dan menunjukkan kedua tangannya yang normal.

Menurut para ahli, ini pertama kalinya seorang pemimpin dunia mencoba secara terbuka untuk membuktikan dia bukan AI – dan hasilnya gagal total.

Analisis Ahli: Video Netanyahu Asli Tapi Sulit Dipercaya

Semua pakar yang saya wawancarai sepakat video-video Netanyahu itu asli. Jeremy Carrasco, salah satu pendiri Riddance, publikasi independen bidang media AI, cepat menyimpulkan bahwa video tersebut normal dan nyata. Pantulan cahaya pada telapak tangan Netanyahu yang tampak seperti jari keenam hanyalah efek cahaya biasa, bukan kesalahan AI.

"Keenam jari bukan lagi ciri AI," kata Carrasco. Alat AI terbaik tidak membuat kesalahan itu lagi. Selain itu, ada momen ketika Netanyahu menyenggol mikrofon dan suara terputus muncul, yang sangat sulit dipalsukan AI. (Anda dapat melihat penjelasan lengkapnya dalam video BBC Verify tentang klaim palsu AI Netanyahu.)

Video di kedai kopi juga nyata menurut Hany Farid, profesor forensik digital di Universitas California, Berkeley, dan pendiri GetReal Security. Timnya melakukan analisis suara, deteksi wajah frame demi frame, pemeriksaan cahaya dan bayangan secara teliti. "Tidak ada bukti video ini dihasilkan oleh AI," ujarnya.

Namun, meski sudah ada tiga video bukti, skeptis tetap tidak percaya. Jika Netanyahu saja gagal membuktikan dirinya nyata, bagaimana dengan kita?

Bisakah Anda Membuktikan Anda Bukan Robot?

Saat wawancara, saya bertanya kepada Farid apakah ada cara agar saya bisa membuktikan saya bukan AI secara langsung. Jawabannya singkat: tidak ada cara pasti.

"Ada beberapa cara untuk menguji dan memperkecil kemungkinan, tapi pada akhirnya, saya tidak bisa yakin 100% jika kamu nyata atau tidak," kata Farid. "Kamu di New York, saya di Berkeley, California. Kita hanya berkomunikasi lewat video. Kamu bisa saja pura-pura."

Fakta ini sangat mengejutkan karena menandakan bahwa tanpa langkah-langkah tambahan, bukti langsung melalui video panggilan saja tidak cukup meyakinkan. Bahkan Samuel Woolley, pakar studi disinformasi dari Universitas Pittsburgh, mengatakan bahwa bagi rata-rata orang atau mereka yang paham teknologi sekalipun, sulit memastikan seseorang itu asli.

Solusi Tradisional: Kata Sandi Rahasia

Para ahli merekomendasikan solusi sederhana tapi efektif: kata sandi rahasia atau kode khusus. Keluarga, teman, atau rekan bisnis harus memiliki kata rahasia yang hanya diketahui bersama, yang dapat digunakan untuk memverifikasi identitas di situasi mencurigakan.

"Saya dan istri punya kode rahasia jika ada panggilan yang mencurigakan," kata Farid. "Kami belum pernah menggunakannya, tapi saya sesekali mengujinya agar tidak lupa." Ini adalah bentuk otentikasi multifaktor yang rumit tapi sangat diperlukan di era deepfake.

Ancaman Nyata Deepfake di Kehidupan Sehari-hari

Penipuan deepfake yang memanfaatkan AI untuk menipu korban kini meningkat pesat. Menurut American Association of Retired Persons (AARP), scam berbasis AI naik hingga 20 kali lipat antara 2023 dan 2025. Korban mulai dari individu biasa hingga perusahaan besar. Contohnya, perusahaan teknik Inggris, Arup, kehilangan 25 juta dolar setelah penipuan menggunakan suara palsu CFO mereka.

Masalah ini semakin memburuk di banyak konflik global. Pada awal invasi Rusia ke Ukraina, deepfake masih kasar dan mudah dikenali. Namun, di Gaza dan Venezuela, jumlah konten palsu jauh lebih banyak dan lebih meyakinkan. Iran bahkan membawa teknologi ini ke level baru yang menakutkan.

Dampak "Dividen Pembohong" dan Krisis Kepercayaan

Fenomena ini dikenal dengan istilah "liar's dividend", yaitu saat seseorang bisa meragukan bukti asli karena biaya membuktikan keaslian sangat mahal, sedangkan menebar keraguan sangat murah. Politisi dan pejabat menggunakan tuduhan deepfake untuk menyangkal bukti nyata, namun hal ini justru menciptakan krisis kepercayaan yang meluas.

Samuel Woolley menegaskan, "Politisi yang mendorong kurangnya moderasi kini menghadapi konsekuensi dari tindakan mereka sendiri." Situasi ini memperparah kebingungan dan ketidakpastian di masyarakat.

Pengalaman Pribadi dan Refleksi Akhir

Kembali ke panggilan dengan bibi saya, Eleanor, realitas terasa semakin kabur. Ternyata dia sudah menggunakan kode rahasia bersama keluarganya, tapi saya belum masuk dalam lingkaran itu. "Aku baca banyak cerita soal suara yang dicloning dari YouTube," katanya. "Itu menakutkan." Dia bahkan menguji saya dengan membacakan lelucon dari Facebook dan mengamati reaksi saya.

Meskipun saya tertawa, dia tetap belum bisa memastikan. Ketika saya bilang saya ingin sweter hitam daripada emas yang pernah kami bicarakan, dia malah curiga, menganggap jawaban itu terlalu "robotik". Setelah saya jelaskan bahwa saya benar-benar orang asli, panggilan berakhir dengan kata-kata penuh kasih: "Aku tidak yakin, tapi aku sayang kamu."

Analisis Redaksi

Menurut pandangan redaksi, kasus ini menyoroti tantangan besar di era AI yang semakin canggih. Sulitnya membuktikan keaslian seseorang bukan hanya soal teknologi, tapi juga soal kepercayaan sosial yang mulai terkikis. Jika perdana menteri sekaliber Netanyahu pun gagal meyakinkan publik, ini menandakan krisis identitas digital yang meluas.

Kedepannya, masyarakat perlu mengadopsi metode verifikasi yang lebih kreatif dan personal, seperti kode rahasia, serta meningkatkan literasi digital untuk mengenali dan menghadapi ancaman deepfake. Pemerintah dan institusi juga harus memperkuat regulasi dan teknologi pendeteksi deepfake agar tidak menjadi lahan subur bagi penipuan dan disinformasi.

Jangan anggap enteng kecanggihan AI ini. Anda bisa jadi target berikutnya. Selalu waspada dan gunakan metode verifikasi terpercaya dalam komunikasi penting.

Untuk informasi lebih lanjut, Anda dapat membaca artikel asli di BBC Future dan ikuti perkembangan teknologi di media terpercaya.

What's Your Reaction?

Like

0

Like

0

Dislike

0

Dislike

0

Love

0

Love

0

Funny

0

Funny

0

Angry

0

Angry

0

Sad

0

Sad

0

Wow

0

Wow

0

/data/photo/2026/05/15/6a06b504d3e2c.png)

/data/photo/2024/03/25/66005fc993ed1.jpg)