OpenAI Tangani Celah Eksfiltrasi Data ChatGPT dan Kerentanan Token GitHub Codex

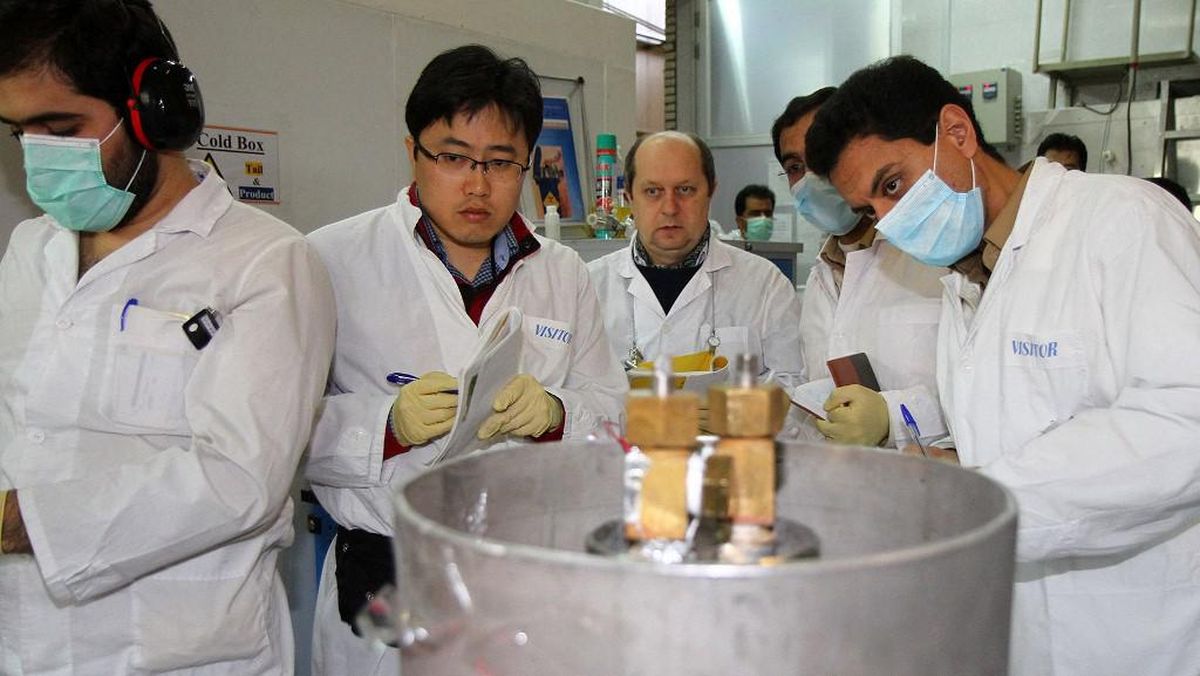

OpenAI baru-baru ini memperbaiki dua kerentanan keamanan kritis yang ditemukan pada platform ChatGPT dan Codex mereka, yang berpotensi membuka celah bagi pencurian data sensitif serta kompromi token GitHub. Temuan ini menyoroti peningkatan risiko keamanan yang dihadapi perusahaan saat mengintegrasikan teknologi kecerdasan buatan (AI) dalam lingkungan kerja mereka.

Celah Eksfiltrasi Data pada ChatGPT

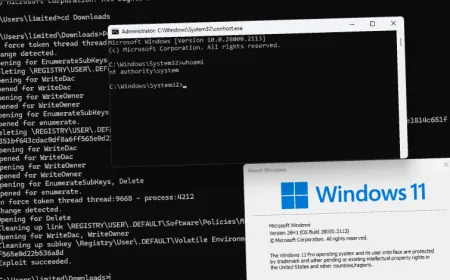

Menurut laporan dari perusahaan keamanan siber Check Point, sebuah vulnerability sebelumnya tidak diketahui memungkinkan data percakapan pengguna ChatGPT dieksfiltrasi tanpa sepengetahuan maupun persetujuan mereka. Celah ini dieksploitasi melalui prompt jahat yang mampu mengubah percakapan normal menjadi saluran komunikasi tersembunyi.

“Sebuah prompt jahat tunggal cukup untuk mengubah percakapan biasa menjadi saluran eksfiltrasi rahasia, membocorkan pesan pengguna, file yang diunggah, dan konten sensitif lain,” jelas Check Point dalam laporannya.

OpenAI menanggapi laporan ini dengan cepat dan memperbaiki masalah tersebut pada 20 Februari 2026. Tidak ditemukan indikasi eksploitasi secara luas sebelum perbaikan dilakukan.

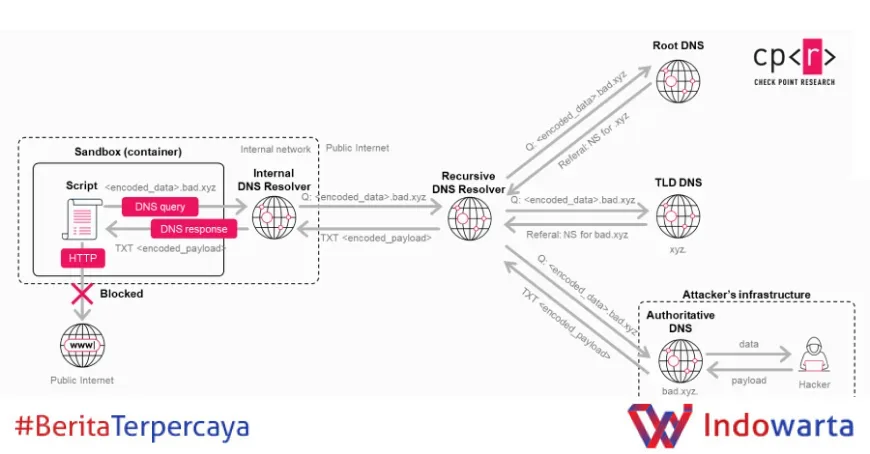

Celah ini memanfaatkan jalur komunikasi tersembunyi berbasis DNS yang tidak terlihat oleh sistem keamanan AI. Dengan mengenkode data ke dalam permintaan DNS, penyerang dapat melewati berbagai perlindungan yang ada, termasuk firewall internal dan pembatasan jaringan yang diterapkan oleh ChatGPT.

Lebih jauh lagi, teknik ini memungkinkan eksekusi perintah jarak jauh dan akses shell ke lingkungan Linux yang digunakan ChatGPT untuk menjalankan kode, tanpa ada peringatan atau persetujuan pengguna.

Skema serangan ini bisa terjadi jika pengguna, misalnya, tertipu untuk menyalin prompt berbahaya yang diklaim dapat membuka fitur premium atau meningkatkan performa ChatGPT. Ancaman semakin besar saat teknik ini disisipkan ke dalam GPT khusus (custom GPT), di mana kode jahat sudah terintegrasi sebelumnya tanpa keterlibatan langsung pengguna.

Check Point menambahkan, “Model AI menganggap lingkungan ini terisolasi dan tidak menyadari adanya transmisi data keluar yang harus dicegah atau dikonfirmasi pengguna, sehingga kebocoran berlangsung tanpa terdeteksi.”

Dengan semakin banyaknya organisasi yang menggunakan ChatGPT untuk mengolah data sensitif, risikonya pun meningkat. Oleh karena itu, perusahaan disarankan untuk membangun lapisan keamanan tambahan guna mencegah serangan injeksi prompt dan perilaku tidak terduga lain dari AI.

“Penelitian ini menegaskan satu kebenaran keras di era AI: jangan pernah menganggap alat AI sudah aman secara default,” kata Eli Smadja, kepala riset Check Point Research.

Kerentanan Command Injection pada OpenAI Codex

Selain itu, ditemukan juga kerentanan injection perintah kritis di Codex, agen rekayasa perangkat lunak berbasis cloud dari OpenAI. Kerentanan ini memungkinkan pencurian token akses GitHub, yang dapat membahayakan banyak pengguna yang berinteraksi dengan repositori bersama.

“Kerentanan ini terdapat pada parameter nama cabang (branch name) GitHub dalam permintaan HTTP pembuatan tugas, memungkinkan penyerang menyelundupkan perintah arbitrer,” jelas Tyler Jespersen dari BeyondTrust Phantom Labs.

Masalah ini disebabkan oleh sanitasi input yang tidak memadai saat Codex memproses nama cabang GitHub. Penyerang dapat menyisipkan perintah berbahaya melalui parameter tersebut, yang kemudian dijalankan di dalam kontainer agen Codex yang berjalan di cloud.

Akibatnya, peretas bisa mendapatkan token akses pengguna GitHub, yang digunakan Codex untuk autentikasi, serta melakukan pergerakan lateral dan mengakses penuh kode sumber korban.

OpenAI telah menambal celah ini pada 5 Februari 2026, setelah laporan awal diterima pada 16 Desember 2025. Kerentanan ini berdampak pada berbagai platform Codex, termasuk situs ChatGPT, Codex CLI, SDK, dan ekstensi IDE Codex.

Menurut BeyondTrust, teknik injection ini juga bisa diperluas untuk mencuri token akses instalasi GitHub dan mengeksekusi perintah bash di kontainer review kode saat Codex disebutkan dalam komentar pull request.

“Dengan cabang berbahaya yang disiapkan, kami menyebut Codex dalam komentar PR. Codex kemudian memulai kontainer review kode, membuat tugas terhadap repositori kami, mengeksekusi payload kami, dan mengirimkan respons ke server eksternal,” jelas BeyondTrust.

Temuan ini menggarisbawahi risiko yang berkembang dari akses istimewa yang diberikan kepada agen AI pengkodean, yang dapat dimanfaatkan sebagai jalur serangan masif ke sistem perusahaan tanpa terdeteksi oleh kontrol keamanan tradisional.

BeyondTrust mengingatkan, “Seiring AI semakin terintegrasi dalam alur kerja pengembang, keamanan kontainer tempat mereka berjalan dan input yang mereka proses harus diperlakukan dengan ketelitian setara aplikasi lain.”

Analisis Redaksi

Menurut pandangan redaksi, insiden ini menandai peringatan penting bagi seluruh ekosistem teknologi dan bisnis yang semakin mengandalkan AI. Celah yang memungkinkan data bocor lewat saluran tersembunyi dan injeksi perintah di Codex menunjukkan bahwa AI bukan hanya alat pintar, tetapi juga sebuah lingkungan komputasi kompleks yang memerlukan pengamanan berlapis.

Ketergantungan berlebihan pada perlindungan bawaan platform AI tanpa pengawasan independen bisa membuka pintu lebar bagi serangan siber yang lebih canggih dan sulit dideteksi. Terlebih, metode serangan seperti eksfiltrasi data via DNS atau penyelundupan perintah lewat parameter input mencerminkan evolusi teknik serangan yang memanfaatkan keunikan arsitektur AI.

Ke depan, perusahaan harus mengembangkan strategi keamanan yang holistik, termasuk audit keamanan rutin terhadap integrasi AI, pelatihan kesadaran keamanan bagi pengguna, dan penerapan kontrol keamanan tambahan di lapisan aplikasi dan jaringan. Selain itu, regulasi dan standar keamanan AI juga harus segera diperkuat untuk menghadapi tantangan yang terus berkembang.

Untuk pembaruan dan analisis lebih lanjut terkait keamanan AI, pembaca dapat mengikuti berita terbaru di situs resmi The Hacker News dan sumber terpercaya lainnya.

What's Your Reaction?

Like

0

Like

0

Dislike

0

Dislike

0

Love

0

Love

0

Funny

0

Funny

0

Angry

0

Angry

0

Sad

0

Sad

0

Wow

0

Wow

0

/data/photo/2025/01/23/6791c483dae68.jpg)

:quality(30):format(webp):focal(0.5x0.5:0.5x0.5)/jakarta/foto/bank/originals/Perumda-Dharma-Jaya-siapkan-900-ekor-sapi-sebagai-stok-hewan-kurban.jpg)

:strip_icc():format(jpeg)/kly-media-production/medias/6100795/original/095270100_1778986735-Vicky_Shu_2.jpg)