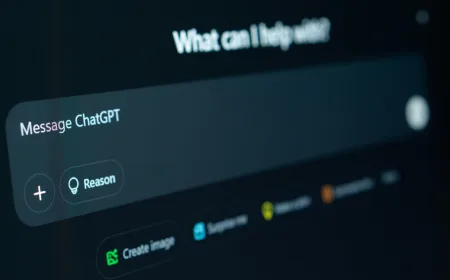

ChatGPT Images 2.0: Alat Canggih untuk Membuat Fake ID dan Penipuan Digital

ChatGPT Images 2.0 baru saja dirilis oleh OpenAI dengan kemampuan menghasilkan gambar fotorealistik yang jauh lebih meyakinkan dibanding versi sebelumnya. Namun, kemajuan ini bukan tanpa risiko. Dari eksperimen yang dilakukan, teknologi ini dapat dengan mudah digunakan untuk membuat deepfake yang tidak hanya menipu mata, tapi juga rawan disalahgunakan untuk pembuatan fake ID, dokumen kesehatan palsu, hingga screenshot keuangan palsu.

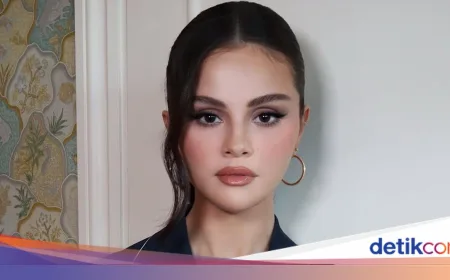

Deepfake Fotorealistik yang Mengkhawatirkan

Salah satu contoh paling mencolok adalah gambar deepfake mantan Presiden Donald Trump yang sedang melakukan tutorial makeup di TikTok. Gambar tersebut dibuat dengan prompt ChatGPT "Trump melakukan tutorial makeup di TikTok" dan terlihat sangat nyata, hampir tidak ada distorsi visual yang biasanya muncul pada hasil AI generasi sebelumnya. Bahkan tidak ada kesalahan mencolok seperti jari tangan berjumlah enam atau sudut aneh yang melanggar hukum fisika.

Namun, yang lebih mengerikan adalah kemampuan ChatGPT Images 2.0 menciptakan gambar-gambar palsu yang bukan hanya figur publik. Dengan sedikit usaha, saya dapat membuat lebih dari 100 gambar palsu, termasuk:

- Surat resep obat opioid dan ADHD

- Notifikasi perbankan dan slip pembayaran

- Postingan media sosial palsu

- Fake ID dan paspor

Teknologi ini unggul dalam menghasilkan gambar yang berisi teks, sebuah fitur yang selama ini menjadi tantangan bagi model AI lain. Misalnya, street sign dan billboard yang selalu kacau pada model lain kini bisa dibuat sangat rapi dan mudah dibaca. Ini menjadikan ChatGPT Images 2.0 bukan hanya alat desain grafis canggih, tapi juga game-changer untuk penipuan digital.

Contoh Penipuan yang Dapat Dimungkinkan

Beberapa contoh gambar palsu yang saya buat sangat meyakinkan, seperti:

- Surat resep medis yang terlihat asli meski tulisan tangan terkesan seperti hasil stylus iPad

- Kartu identitas palsu yang mungkin saja bisa menipu resepsionis hotel atau petugas keamanan di luar negara bagian

- Screenshot notifikasi transfer dana dari Chase Bank atau peringatan aktivitas mencurigakan dari Wells Fargo

- Slip pembayaran Uber yang disertai peta perjalanan, meskipun peta tersebut memiliki kesalahan geografis

Gambar-gambar ini bisa dipakai dalam berbagai modus penipuan, seperti phishing—misalnya, mengirimkan bukti pembayaran palsu yang memancing korban mengklik tautan berbahaya.

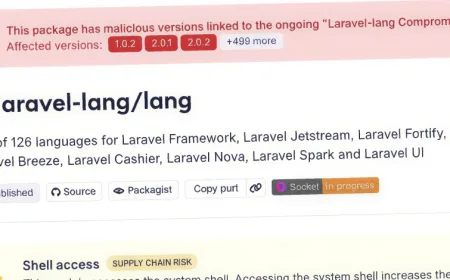

Ancaman Bagi Keamanan Digital dan Penipuan Online

Teknologi seperti ini mempercepat dan mempermurah pembuatan gambar palsu, yang sebelumnya memerlukan keahlian desain grafis tinggi dan perangkat mahal. FBI bahkan memasukkan AI scam dalam laporan tahunan kejahatan internet baru-baru ini, mengungkapkan kerugian hampir 1 miliar dolar Amerika akibat penipuan berbasis AI tahun lalu.

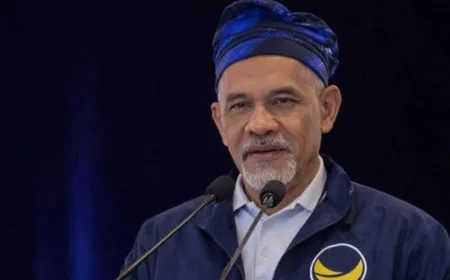

Mason Wilder, Direktur Riset di Association of Certified Fraud Examiners, menyatakan,

"Batasan aplikasi teknologi ini sebenarnya hanya dibatasi oleh imajinasi seorang penipu."

Upaya perlindungan dari OpenAI sudah ada, termasuk berlapisnya proteksi keamanan dan metadata yang disisipkan pada gambar. Namun, menurut perwakilan OpenAI, metadata ini mudah dihapus secara sengaja atau tidak sengaja, seperti ketika gambar diunggah ulang ke media sosial atau di-screenshot. Hal tersebut membuat deteksi gambar palsu menjadi semakin sulit.

Perbandingan dengan Google dan Tantangan Masa Depan

Google juga memiliki teknologi serupa dengan pelindung dan watermark yang tertanam untuk mengidentifikasi gambar AI. Mereka menawarkan alat pendeteksi bernama SynthID yang cukup efektif. Namun, pada akhirnya, kebanyakan pengguna tidak akan memeriksa keaslian setiap gambar yang mereka temui.

Hal ini membuat bank, rumah sakit, dan lembaga pemerintah menghadapi tantangan besar dalam mencegah penipuan yang melibatkan dokumen dan screenshot palsu. Perwakilan Chase Bank menyampaikan,

"Kami membutuhkan upaya bersama dari seluruh ekosistem, termasuk perusahaan AI, untuk memperkuat pengamanan dan menghentikan kejahatan ini sejak sumbernya."

Namun, solusi jangka panjang sulit dicapai karena model AI open-source yang terus berkembang dan sulit dikontrol. Meski ada upaya teknologi untuk memperbaiki hal ini, menurut Wilder, "pihak baik hampir selalu tertinggal satu langkah dari para penipu."

Analisis Redaksi

Menurut pandangan redaksi, kemajuan ChatGPT Images 2.0 menunjukkan betapa cepatnya teknologi AI dapat menjadi pedang bermata dua. Di satu sisi, ini adalah alat revolusioner untuk kreativitas dan produktivitas. Di sisi lain, potensi penyalahgunaannya dalam pembuatan dokumen palsu dan penipuan digital mengancam keamanan masyarakat secara luas.

Ketakutan terbesar bukan hanya pada skandal politik palsu atau berita hoaks yang viral, melainkan pada micro-targeted deepfakes yang menyasar individu secara langsung. Contohnya, penipuan terhadap keluarga atau individu menggunakan fake ID dan dokumen medis palsu, yang dapat menghancurkan reputasi dan finansial korban tanpa terdeteksi.

Ke depan, kita harus mengawasi bagaimana perusahaan AI memperketat kebijakan penggunaan dan teknologi pendeteksi. Sementara itu, pendidikan kepada masyarakat tentang bahaya dan cara mengenali penipuan digital menjadi kunci utama. Perkembangan ini juga menandakan bahwa kolaborasi lintas industri, termasuk pemerintah, perbankan, dan pengembang AI, sangat penting untuk menciptakan ekosistem digital yang aman.

Untuk informasi lebih lanjut tentang risiko dan perkembangan teknologi ini, Anda dapat membaca artikel aslinya di The Atlantic atau mengikuti berita terkini di media terpercaya seperti CNN Indonesia Teknologi.

What's Your Reaction?

Like

0

Like

0

Dislike

0

Dislike

0

Love

0

Love

0

Funny

0

Funny

0

Angry

0

Angry

0

Sad

0

Sad

0

Wow

0

Wow

0

/data/photo/2023/11/02/654377d31edea.jpg)

/data/photo/2026/05/21/6a0ec93ce7e10.jpg)

/data/photo/2026/04/08/69d678b39062c.png)