Kelemahan OpenClaw AI Bisa Sebabkan Prompt Injection dan Kebocoran Data

Kelemahan keamanan pada OpenClaw AI agent baru-baru ini menjadi sorotan setelah peringatan resmi dari Tim Tanggap Darurat Komputer Jaringan Nasional China (CNCERT). OpenClaw, sebuah agen kecerdasan buatan (AI) otonom berbasis open-source dan self-hosted, dinilai memiliki konfigurasi keamanan default yang lemah yang bisa dimanfaatkan oleh pihak jahat untuk melakukan prompt injection dan kebocoran data.

Dalam sebuah postingan di WeChat, CNCERT mengungkapkan bahwa kelemahan bawaan pada OpenClaw, dikombinasikan dengan akses istimewa yang dimilikinya untuk menjalankan tugas secara otomatis, membuat sistem rentan diretas dan dikendalikan oleh penyerang melalui teknik manipulasi prompt.

Ancaman Prompt Injection dan Indirect Prompt Injection (IDPI)

Prompt injection terjadi ketika instruksi berbahaya disisipkan dalam konten web sehingga agen AI dapat diarahkan untuk membocorkan informasi sensitif. Dalam kasus OpenClaw, ini disebut juga sebagai indirect prompt injection atau cross-domain prompt injection (XPIA), di mana penyerang tidak berinteraksi langsung dengan model bahasa besar (LLM), melainkan memanfaatkan fitur AI seperti rangkuman halaman web atau analisis konten untuk mengeksekusi instruksi berbahaya.

OpenAI pernah menyatakan dalam sebuah posting blog bahwa serangan prompt injection ini kini semakin maju, melibatkan teknik rekayasa sosial untuk mengecoh sistem AI yang dapat menjelajah web dan menjalankan aksi atas nama pengguna.

“Agen AI semakin mampu menjelajah web, mengambil informasi, dan bertindak atas nama pengguna. Kemampuan ini berguna, namun juga membuka celah baru bagi penyerang untuk memanipulasi sistem.”

Kasus Praktis: Eksfiltrasi Data Melalui Pratinjau Tautan

Bukti nyata dari kerentanan ini ditemukan oleh peneliti di PromptArmor yang menunjukkan bahwa fitur pratinjau tautan dalam aplikasi pesan seperti Telegram dan Discord dapat dimanfaatkan untuk menyusupkan data rahasia saat berkomunikasi dengan OpenClaw.

Metode yang digunakan adalah menipu AI agent agar menghasilkan URL yang dikendalikan penyerang. Ketika URL tersebut ditampilkan sebagai pratinjau tautan di aplikasi pesan, data sensitif secara otomatis terkirim ke server penyerang tanpa perlu pengguna mengklik tautan tersebut.

“Dalam sistem agen dengan pratinjau tautan, eksfiltrasi data bisa terjadi segera setelah agen AI merespons pengguna, tanpa tindakan klik dari pengguna,” jelas PromptArmor.

Risiko Lain yang Diungkap CNCERT

Selain prompt injection, CNCERT juga menggarisbawahi tiga risiko utama dari penggunaan OpenClaw:

- Penghapusan data kritis secara tidak sengaja akibat salah tafsir instruksi oleh agen AI.

- Penyebaran malware melalui 'skills' jahat yang dapat diunggah ke repositori seperti ClawHub dan dijalankan di sistem pengguna.

- Eksploitasi kerentanan keamanan terbaru pada OpenClaw yang dapat mengakibatkan kebocoran data dan kompromi sistem.

CNCERT menegaskan bahwa sektor-sektor penting seperti keuangan dan energi sangat rentan terhadap dampak buruk dari insiden ini, yang bisa menyebabkan kebocoran rahasia dagang, kode sumber, hingga lumpuhnya sistem bisnis penting dengan kerugian besar.

Langkah Mitigasi dan Larangan Pemerintah China

Untuk mengurangi risiko, CNCERT menyarankan pengguna dan organisasi melakukan beberapa tindakan pengamanan:

- Memperkuat kontrol jaringan dan menghindari eksposur port manajemen OpenClaw ke internet.

- Mengisolasi layanan OpenClaw di dalam container.

- Menjaga kredensial agar tidak disimpan dalam bentuk plaintext.

- Hanya mengunduh 'skills' dari saluran terpercaya dan menonaktifkan pembaruan otomatis.

- Memastikan agen selalu diperbarui dengan patch terbaru.

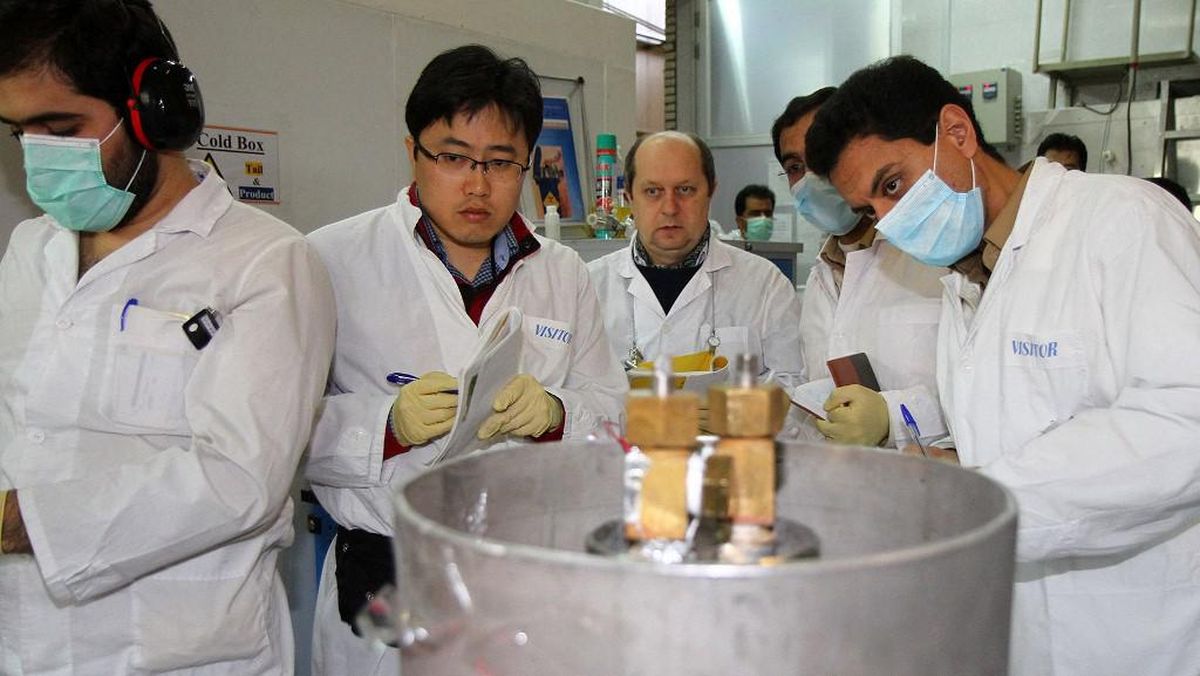

Seiring dengan peringatan ini, pemerintah China juga melarang penggunaan aplikasi OpenClaw AI pada komputer kantor di perusahaan milik negara dan instansi pemerintah, termasuk membatasi akses bagi keluarga personel militer, sebagai upaya menahan risiko keamanan.

Eksploitasi oleh Pelaku Kejahatan Siber

Popularitas OpenClaw ternyata disalahgunakan oleh pelaku kejahatan siber yang menyebarkan repositori GitHub palsu yang mengandung malware seperti Atomic Stealer, Vidar Stealer, dan proxy malware berbasis Golang bernama GhostSocks. Malware ini dikemas dengan instruksi yang menyesatkan agar pengguna mengira itu adalah installer resmi OpenClaw.

“Kampanye ini tidak menargetkan industri tertentu, melainkan pengguna yang mencoba menginstal OpenClaw dengan repositori jahat yang menjadi rekomendasi teratas di hasil pencarian AI Bing untuk OpenClaw Windows,” jelas Huntress, perusahaan keamanan siber.

Analisis Redaksi

Menurut pandangan redaksi, kasus OpenClaw membuka babak baru dalam risiko keamanan AI yang semakin kompleks, terutama dengan kemampuan agen AI untuk berinteraksi secara otonom di internet. Prompt injection bukan lagi sekadar celah teknis, tapi sudah menjadi pintu masuk serangan berbasis rekayasa sosial yang sulit dideteksi.

Larangan pemerintah China terhadap penggunaan OpenClaw di instansi negara menandakan sikap serius dalam menghadapi ancaman siber pada teknologi AI. Namun, hal ini juga menimbulkan pertanyaan tentang bagaimana regulasi dan pengawasan akan berkembang di masa depan, terutama ketika adopsi AI otonom terus meluas di berbagai sektor.

Penting bagi pengguna dan organisasi untuk tidak hanya bergantung pada pengaturan default keamanan produk AI, tetapi juga menerapkan praktik keamanan berlapis dan edukasi terkait potensi serangan baru. Dalam jangka panjang, pengembangan standar keamanan AI yang lebih kuat dan transparan menjadi kebutuhan mendesak untuk mencegah penyalahgunaan teknologi yang seharusnya memberdayakan manusia.

Ke depan, kita perlu mengawasi dengan ketat inovasi dan ancaman baru di ranah AI, serta kesiapan institusi dalam merespons risiko-risiko yang muncul agar teknologi ini dapat dimanfaatkan secara aman dan bertanggung jawab.

What's Your Reaction?

Like

0

Like

0

Dislike

0

Dislike

0

Love

0

Love

0

Funny

0

Funny

0

Angry

0

Angry

0

Sad

0

Sad

0

Wow

0

Wow

0

:strip_icc():format(jpeg)/kly-media-production/medias/5123488/original/058050100_1738817537-Screen_Shot_2025-02-06_at_11.38.23.jpg)

/data/photo/2026/05/16/6a07fd9d7ebd8.jpg)

/data/photo/2026/05/07/69fc82cd8ce26.jpg)

/data/photo/2022/02/28/621c832c944dd.jpg)

:strip_icc():format(jpeg)/kly-media-production/medias/6100795/original/095270100_1778986735-Vicky_Shu_2.jpg)